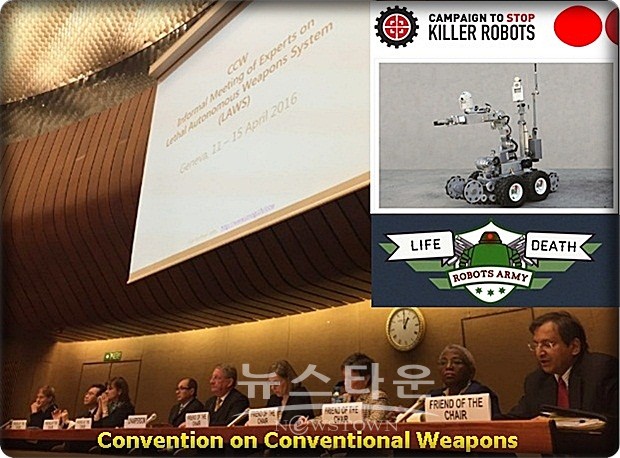

전쟁터에서 적군의 공격목표(attack targets)를 사전에 탐지하고, 스스로 그 적을 선별하며 살상하는 치명적인 자동무기시스템(lethal autonomous weapons systems)인 이른바 ‘살인 로봇 무기(Killer Robot)’에 대한 규제책을 논의하는 첫 정부 간 전문가 회의가 2017년도에 제네바에서 열릴 전망이다.

인공지능(AI=Artificial Intelligence)은 예상보다 훨씬 빠른 속도로 진보를 거듭하고 있는 가운데 이와는 대조적으로 ‘살인로봇’에 대한 규제는 논의되지 않고 있어 문제점으로 지적되고 있다. 세계 20개국 이상의 비정부기구(NGO)들은 아예 ‘살인로봇 개발 금지’를 해야 한다고 주장하고 나서고 있다.

물론 살인로봇이라는 존재는 아직은 없을 뿐만 아니라 겉으로 이 같은 로봇을 개발하겠다는 국가는 아무도 없다. 그러나 인공지능을 가진 로봇의 기능은 다양하기 때문에 어떠한 가능성도 배제할 수 없다. 따라서 인공지능의 살인로봇 개발 능력이 있는 일부 국가들의 속내는 전쟁이 발발할 때 살인 로봇을 실전에 투입하게 되면 자국군 병사의 희생을 줄일 수 있다는 달콤한 유혹이 존재하고 있다.

따라서 처음부터 살인 로봇 자체를 개발하지 못하도록 하는 국제법을 제정해야 한다는 목소리(Campaign to Stop Killer Robot Campaign)와 함께 부득이한 경우 “국제법에 근거한 프로그램을 만들어 넣으면 비인도적인 살상은 하지 않을 것”이라는 견해도 나오고 있다.

현재까지 특정재래식무기금지협약(CCW)의 비공식 전문가 회의에서 ‘사전에 살인로봇을 금지해야 한다’고 주장한 국가는 14개국으로 알제리, 칠레, 볼리비아, 코스타리카, 에콰도르, 쿠바, 이집트, 가나, 바티칸, 멕시코, 니카라과, 파키스탄, 팔레스타인, 짐바브웨 등이다. 주요 선진국은 모두 빠져 있는 상황이다. 살인로봇 개발 금지를 해야 한다는 목소리를 지지하는 나라는 점진적으로 늘어나고 있지만 진전은 아주 더디다.

한국도 지난 2013년 11월 14일 이른바 ‘살인로봇’에 대한 논의가 우선적으로 논의돼야 한다는 입장을 개진한 67개 국가 중의 하나이다.

현 단계에서 다양한 형태의 문제점들이 나타난다. 인공지능도 기계이다. 고장 없는 기계는 없다. 따라서 테러리스트가 살인 로봇을 손에 넣었을 경우, 그 폐해는 이루 상상할 수 없을 정도이다. 살인로봇은 병사의 인명에 신경 쓸 필요가 없게 되기 때문에 전쟁의 시작을 위한 장벽이 그만큼 낮아질 수 있다는 점에서 군대의 강력한 살인 로봇 개발 지지를 어떻게 막아 내느냐도 작은 문제가 아니다.

여기에 윤리적인 문제도 내포되어 있다. “원초적으로 인간의 생사를 기계인 로봇에 맡겨야 하는 것인가?”라는 윤리적 문제제기도 되고 있다.

국제인권단체인 휴먼라이츠워치(HRW=Human Rights Watch)는 미국과 중국 등 최소한 6개국 정도가 이른바 살인로봇 개발 능력이 있는 것으로 보고 있다. HRW의 메리 웨리험은 “수 십년 후가 아니라 수년 후에 개발될 가능성도 있다”며 사전 경고음을 발하고 있다.

지금까지 살인로봇에 대해서는 특정재래식무기금지협약(CCW=Convention on Conventional Weapons) 체결국 회의가 지난 2013년부터 비공식 전문가회의를 해왔으며, 올 12월 16일에 제 5차 비공식 전문가 검토회의(Review Conference)가 열리는 쪽으로 방향이 잡혔다.

한편, CCW의 관계자는 "살인로봇을 어떻게 정의하는가?" 등 많은 논점이 남아 있어 규제 조약의 초안을 곧 바로 작성할 수 있는 상황이 아니라고 지적하면서 “논의의 진전을 기대하는 것은 경솔하다”고 말했다.

뉴스타운

뉴스타운TV 구독 및 시청료 후원하기

뉴스타운TV

![[특별대담] 제22대 국회의원 선거 자유민주당 인천 서구병 이진기 예비후보](/news/photo/202403/600022_545770_3853.jpg)

![[긴급시국분석] 북한의 내년 4월 총선 전후 기습남침과 좌파들의 내란 및 전민봉기 철저히 대비하라!](/news/thumbnail/202312/592978_536686_4219_v150.jpg)